副标题:对最新的前沿技术——驱动最大互联网公司的算法,注册机构的用户手册揭示了中国的监管方法

来源:Carnegie Endowment for International Peace

作者:马特·希恩 (Matt Sheehan) ,莎朗·杜(Sharon Du)

译者:撒母耳

在过去的一年里,中国政府一直在进行一些最新的实验,以建立管控人工智能 (AI) 的监管工具。在此过程中,中国正试图解决世界各国政府即将面临的一个问题:监管机构能否深入了解算法的运作,并确保它们在可接受的范围内运行?

一个特别的工具值得关注,既因为它在中国的影响,也因为其他国家的技术专家和政策制定者可以从中吸取经验:中国互联网监管机构为算法推荐服务而创建的强制注册机制。

尽管这种注册的全部细节并未公开,但通过深入研究其在线说明手册,我们可以对中国新兴的算法监管架构,有新的洞察。

注册系统的建立

这个算法注册系统,是根据中国 2022 年的《互联网信息服务算法推荐管理规定》(英译:China’s 2022 regulation on recommendation algorithms)而创建的,该规定于今年3月生效,由“国家互联网信息办公室”(Cyberspace Administration of China,CAC) 牵头。中国的算法监管,主要集中在算法推荐服务在信息传播中的作用,要求服务提供者确保其不“危害国家安全或社会公共利益”,并在损害用户合法利益时“作出解释”。其他条款试图解决平台的垄断行为和社会热点问题,例如在给中国送货司机制造危险的劳动状况方面,调度算法所起的作用。

该《规定》还要求,具有“舆论属性”(public opinion characteristics)和“社会动员能力”(social mobilization capabilities)的算法推荐服务,必须向名称神秘的“互联网信息服务算法备案系统”(Internet Information Service Algorithm Filing System),完成备案。但这些规定没有详细说明具体内容,而备案要求在当时基本没有引起注意。

2022年8月,“国家互联网信息办公室”(CAC)发布了第一批30个算法的注册文件,分析人员才第一次看到了这些文件。通过注册网页可访问的这些文件,有中国最大的一些互联网平台公司的算法,包括腾讯、阿里巴巴和字节跳动。这些公开可访问的文件,通常是单一的页面,其中有6个不同的简短回复类别,包括“算法基础”和“算法运行机制”。

但这些备案文件中的实际描述过于笼统,几乎完全缺乏有意义的细节。例如,微博“热搜”功能的备案文件,将算法描述为“搜索热度、讨论热度和传播热度”相加,乘以“互动率系数”(interaction rate coefficient)。这可能是一个准确的描述,但它的标准也很高,以至于不了解该特定算法的观察者基本上可以猜到它。如果这是提供给中国监管机构的全部信息,那么关于算法、算法如何训练或算法如何执行,它将不会给监管者提供任何有意义的认知。

来自用户手册的启示

但是,仔细查看算法注册的登陆页面,其中包含一个可下载的用户手册,供注册其算法的实体使用,从中可以更广泛地了解“网信办”实际在收集什么信息。仔细阅读该手册并检查其中的截图,就会发现,提交注册备案的信息中只有部分被披露。

手册中最详细的披露要求,来自于一张截图,该截图显示了披露“详细的算法属性信息”的页面。在这里,它要求算法提供者列出用于训练模型的每个开源和自建数据集的名称,以及该数据的具体来源。此外,它要求提供者说明,算法输入是否涉及生物特征识别(biometric)或其他个人信息。

图1. 算法注册用户手册的注释截图

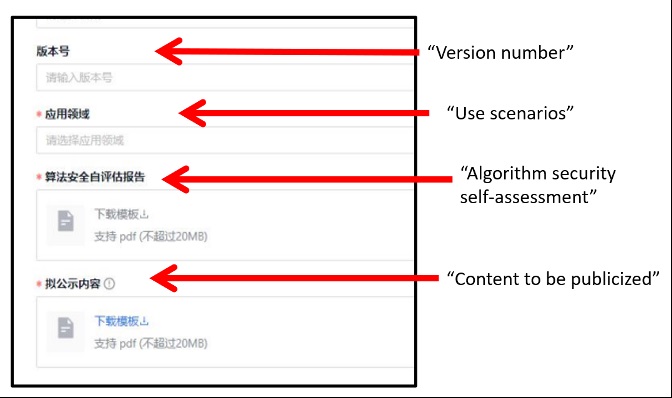

在一个标题为“算法基本属性信息”页面的单独截图中,公司被要求上传“算法安全性自我评估”的PDF文件。由于这些上传文件不对公众开放,我们无法确切知道其中需要哪些信息,也不知道安全性是如何定义的。鉴于该规定强调控制信息的传播,安全性自我评估可能涉及对公共言论的控制,将匹配已注册的算法类型,包括“处理非法信息和内容”的“安全风险识别”算法。但它也可能包括其他问题,如滥用“生成式人工智能模型”(generative AI models)和“对抗性攻击”(adversarial attacks)。

图2:算法注册用户手册的注释截图

其他截图概述了可能需要更多信息的其他部分的标题——“算法策略”、“算法风险和预防机制”——但用户手册没有提供这些页面的截图,因此所需披露的信息仍然是个谜。

通过查阅用户手册,我们发现,注册机构对中国公司的要求,比我们之前所了解的,既有更多的一面,也有更少的一面。更多的一面,是因为该手册揭示了重要的新的披露要求,而这些要求并未出现在文件的公开版本中。列举数据集的要求是不言自明的,而算法安全性的自我评估,既可以粗略,也可以全面。关于要求更少的一面,是因为有些人曾经认为,注册备案的要求,意味着中国政府现在可以直接获取算法或底层代码。但情况似乎并非如此,进一步的报告支持这一结论。

中国以外的比较

最直接相似的监管,存在于欧盟的《数位服务法案》(Digital Services Act,DSA)中,这是一项全新的法律,对推荐算法的透明度和审查,提出了更大的要求——尽管我们还没有看到算法透明度在该法中采取什么形式。当这些被公开时,它们将构成另一个值得关注的算法透明度实验。

另一个可能与中国这项实验类似的,是在人工智能伦理社区中推广“模型卡”(model cards)的运动。“模型卡”最初由谷歌和多伦多大学的研究人员在一篇论文中提出,被定位为“朝着机器学习的负责任的民主化迈出的一步”。大多数“模型卡”提供了一个模型的理想输入形式的简单概述,可视化了一些潜在的限制,并提出了基本的性能指标以反映现实世界的影响。就像中国注册机构的备案一样,许多“模型卡”提供了关于架构、应用场景、训练数据和敏感数据使用的信息。

但是,模型卡倾向于强调性能评估,而中国的算法注册则强调安全评估。在某些情况下,重点可能会重叠;模型卡可能有安全组件,一些提交的备案侧重于减轻对边缘化群体的负面影响,例如从事食品配送工作的移民。但一般来说,模型卡通过比较一个模型在不同人口群体中使用时的表现,来解决对算法偏见的担忧。模型卡既面向专家,也面向非专家的受众。相比之下,中国的算法注册,面向的是政府和提出各种备案的机构,而中国公民并没有被邀请去评估偏见。相反,这仍然是政府的职权范围,政府可以定义什么是安全和风险。目前的注册体制反映并强化了中国共产党作为这些问题的最终仲裁者的角色。

隐藏在所有这些实验背后的,是一个更深的问题:对复杂算法如何运作,在技术上是否有可能获得有意义的透明度?深度学习经常被描述为一种“黑匣子”(black box)技术,因为它所做的预测、决定和建议不容易解释,即使对它的开发者也是如此。算法的可解释性,是机器学习研究的一个活跃领域,但主要问题仍然是何时——如果有这个时间的话——它将达到在监管背景下有用的水平。

“网信办”可能还缺乏体制内的专业技能,无法理解公司提交给算法注册的信息。一份报告描述了“字节跳动”的代表和“网信办”之间的会议,在会议中,字节跳动的员工“不得不依靠比喻和简化语言的组合 “,来与官员沟通。

中国的下一步行动

对于这样一个雄心勃勃的项目,这听起来可能不是一个有利的开始。但在建立新的监管架构时,你必须从某个地方开始。在算法注册之前,中国官员不知道什么是他们不知道的。通过提供对中国有影响力的算法的大概了解,注册系统可以提醒“网信办”在哪些方面可能缺乏有用的信息,并为其提供依据,以进一步要求公司披露信息。

在这个意义上,目前构建工具来监管算法的努力,与中国早期试图控制互联网访问和自由的社交媒体平台的做法,正相呼应。在这两种情况下,中国政府的努力都显得笨拙,而且经常被描述为徒劳无功。但是,通过慢慢形成对技术和行业的了解,中国政府能够加强控制,直到达到一个符合其目的的平衡点。现在,我们将看看它是否能在算法方面玩出同样的把戏。